Elasticsearch Serverless

Zahlen Sie nur für das, was Sie nutzen, ohne sich um die Infrastruktur kümmern zu müssen. Entdecken Sie die Kunst des Möglichen mit KI-Suche, RAG-fähigen Tools und Datenanalysefunktionen.

PreisdetailsIngest*

Bereits ab 0,14 $

pro VCU pro Stunde Search*

Bereits ab 0,09 $

pro VCU pro Stunde Machine Learning

Bereits ab 0,07 $

pro VCU pro Stunde Speicher und Aufbewahrung

Bereits ab 0,047 $

pro aufbewahrtem GB pro Monat* Egress

Schon ab 0,05 $ pro GB

Pro übertragenem GB pro Monat *Vector-Profile erhalten 50 GB kostenlos

Von Elastic verwaltetes Large Language Model (LLM) für AI Playground und AI Assistant

4,50 $ pro Million Eingangstoken21 $ pro Million Ausgangstoken Elastic Inference Service

Bereits ab 0,08 $

pro Million Token Elastic Inference Service unterstützt einen wachsenden Katalog von Modellen. Sehen Sie sich hier die detaillierten Preise für die einzelnen Modelle an und erfahren Sie, welche Modelle heute verfügbar sind und welche noch folgen werden.

Workflows

10.000 Ausführungen kostenlos, danach bereits ab 0,0108 $

Pro Ausführung Agent Builder

1.000 Ausführungen kostenlos, danach bereits ab 0,025 $

Pro Ausführung |

|

| Ingest*Pro VCU pro Stunde | Bereits ab 0,14 $ |

| Search*Pro VCU pro Stunde | Bereits ab 0,09 $ |

| Machine LearningPro VCU pro Stunde | Bereits ab 0,07 $ |

| Speicherung und AufbewahrungPro aufbewahrtem GB pro Monat | Bereits ab 0,047 $ |

| EgressPro übertragenem GB pro Monat *Vector-Profile erhalten 50 GB kostenlos |

Bereits ab 0,05 $

|

| Von Elastic verwaltetes Large Language Model (LLM) für AI Playground, Agent Builder und AI Assistant |

4,50 $

Pro Million Eingangstoken

21 $

Pro Million Ausgangstoken

|

| Elastic Inference Service pro Million Token Elastic Inference Service unterstützt einen wachsenden Katalog von Modellen. Sehen Sie sich hier die detaillierten Preise für die einzelnen Modelle an und erfahren Sie, welche Modelle heute verfügbar sind und welche noch folgen werden. |

Bereits ab 0,08 $

|

| Workflowspro Ausführung |

10.000 Ausführungen kostenlos, danach bereits ab 0,0108 $

|

| Agent BuilderPro Ausführung |

1.000 Ausführungen kostenlos, danach bereits ab 0,025 $

|

*Diese Preise gelten ab dem 1. Dezember 2024. Die Preise für Workflows und Agent Builder gelten ab dem 1. Mai 2026. Besuchen Sie unsere Detailseite zu Cloud-Preisen, um weitere Preisinformationen zu erhalten.

Das Ingest- und Retention-Metering basiert auf dem unkomprimierten, normalisierten, vollständig angereicherten Datenvolumen, das Sie in Ihr Serverless-Projekt einlesen. Die gemessenen Volumina werden viel höher sein als die „Rohdaten“ oder die komprimierten Daten „im Übertragungsweg“.

Supportpaket

Der eingeschränkte Support ist im Standardabonnement enthalten. Die restlichen Supportpreise hängen vom Prozentanteil Ihres Verbrauchs ab. Weitere Informationen zum Umfang der einzelnen Supportebenen finden Sie unter elastic.co/support.

| Elastic Cloud-Abonnementstufe für Organisation* | Standardabonnement | Gold | Platinum | Enterprise |

|---|---|---|---|---|

| Support und Gesamtbetrag | ||||

| Supportebene | Eingeschränkt | Basic | Erweitert | Premium |

| % der Gebühr | Inbegriffen | 5 % | 10 % | 15 % |

* Abonnementstufe wird bei der Registrierung ausgewählt

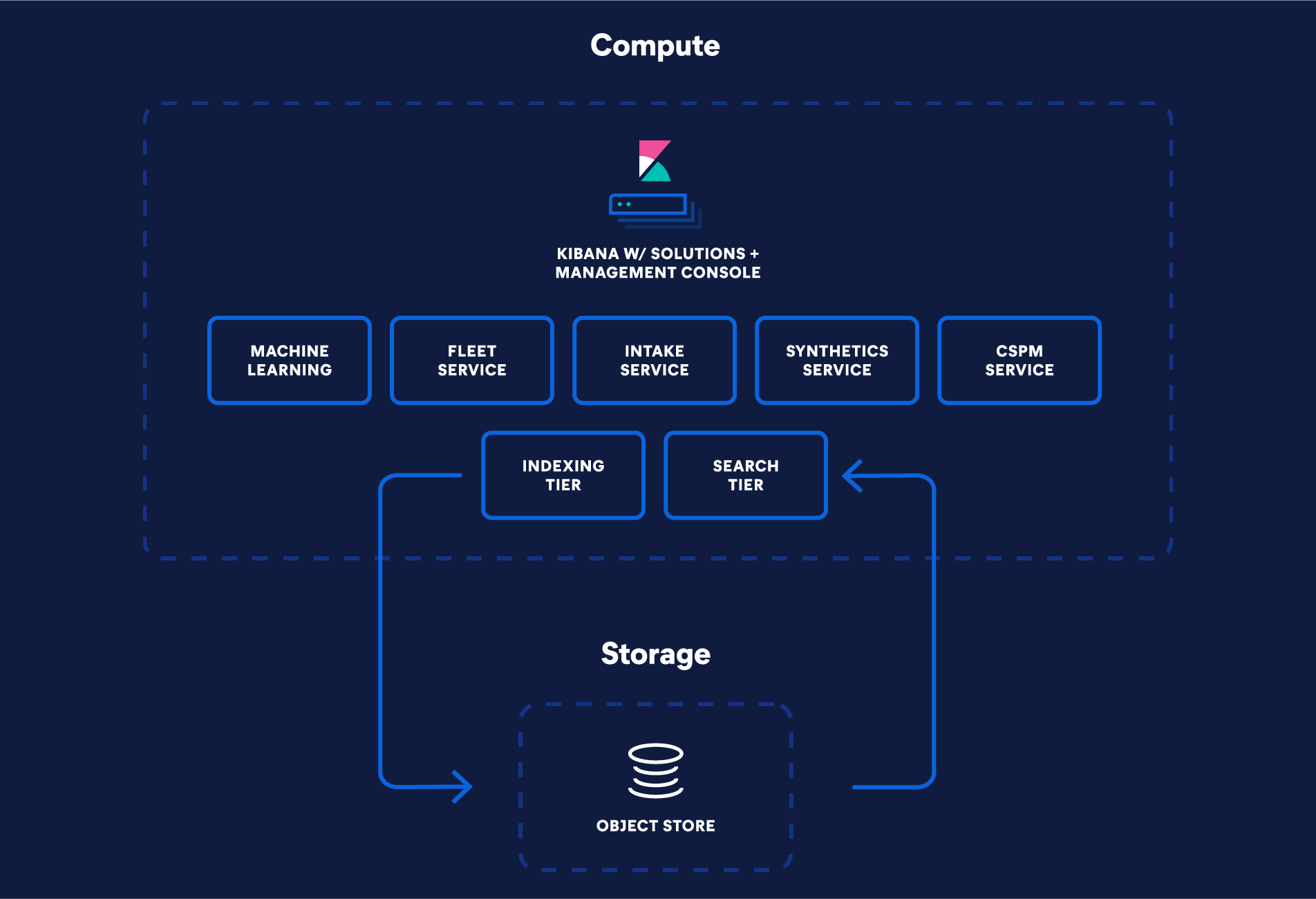

Preiskomponenten von Elasticsearch Serverless

Elasticsearch Serverless berechnet separate Gebühren für Rechenleistung (VCUs mit 1 GB RAM) und Speicher (GB) und bietet skalierbare, leistungsorientierte Preise, um Ihre Latenz- und Durchsatzziele zu erreichen.

Virtual Compute Unit (VCU)

Es gibt drei spezialisierte VCU-Typen, die für bestimmte Aufgaben zur Verfügung stehen.

Ingest-VCUs: Führen die Datenindexierung im Search AI Lake durch.

Search-VCUs: Bearbeiten nutzerorientierte Suchanfragen, Alerting-Regeln, Aggregationen, Transformationen und räumliche Abfragen anhand von Daten im Search AI Lake.

Machine Learning-VCUs: Bearbeiten Inferenz- und ELSER-Workloads sowie Machine-Learning-Jobs.

Token-Nutzung

Nutzung von Elastic Managed Large Language Model pro Million Eingangs- und Ausgangs-Tokens: KI-Features sofort einsatzbereit, ohne ein großes Sprachmodell (LLM) bereitstellen oder betreiben zu müssen.

Abrechnung der Jina-AI-Modellnutzung pro Million Token: Nutzen Sie Jina-AI-Modelle auf der GPU für semantische Such- und Reranking-Anwendungsfälle.

Adaptive Ressourcenbereitstellung

Die Ingest- und ML-Rechenressourcen skalieren automatisch, um den Anforderungen der Arbeitslasten gerecht zu werden.

Search-Rechenressourcen passen sich dynamisch an Workloads an und sorgen für konstante Leistung und Reaktionsschnelligkeit. Mit flexiblen Search-Power-Einstellungen haben Sie die Kontrolle über die Ressourcenzuweisungen, um Ihre Leistungsanforderungen zu erfüllen. Eine Basis von Suchressourcen wird immer bereitgestellt, um Ihre Daten sofort abfragbar zu halten; Leerlaufzeiten werden zu einem reduzierten Satz berechnet.

Speicher und Aufbewahrung

Elasticsearch Serverless verwendet Objektspeicher als persistenten Speicher im Search AI Lake.

Sämtliche Daten sind unabhängig von Art, Aktualität und Nutzungshäufigkeit über den Search AI Lake verfügbar. Die Größe des Search AI Lake kann mit manuellen oder verwalteten Datenaufbewahrungsrichtlinien gesteuert werden.

Der Speicher wird in GB gemessen.

Projektübergreifende Suche, ohne Ihre Daten zu verschieben

Egal, ob Ihre Daten nach Mandant, Geschäftseinheit oder geografischer Region unterteilt sind, Sie können Elastic Cloud Serverless-Projekte sofort einheitlich abfragen.

Die Anzahl der VCUs für die Suche kann bei diesem Projekt steigen, um föderierte Abfragen zu unterstützen. Während der technischen Vorschau werden CPS-Datenübertragungen zwischen Projekten nicht in Rechnung gestellt.

Agentische Suche und Automatisierung

Erstellen und interagieren Sie mit KI-Agenten, die Ihre Daten verstehen, um Genauigkeit und Leistung zu verbessern, und ergreifen Sie Maßnahmen mithilfe von Workflows.

Die Nutzung von KI-Agenten wird über Agent Builder- und Workflow-Ausführungen gemessen.

Häufig gestellte Fragen

Was ist Elasticsearch Serverless?

Was ist Elasticsearch Serverless?

Serverlose Projekte verwenden die Kernkomponenten des Elastic Stack, wie Elasticsearch und Kibana, und basieren auf der Search AI Lake-Architektur von Elastic, die Rechen- und Speicherfunktionen entkoppelt. Such- und Indizierungsvorgänge sind getrennt, was Flexibilität beim Skalieren Ihrer Workloads bietet und gleichzeitig ein hohes Maß an Leistung gewährleistet.

Profitieren Sie von den folgenden Vorteilen von Elasticsearch Serverless:

- Keine Verwaltung. Elastic verwaltet den zugrunde liegenden Elastic-Cluster, sodass Sie sich auf Ihre Daten konzentrieren können. Bei serverlosen Projekten ist Elastic für automatische Upgrades, Daten-Backups und Business Continuity zuständig.

- Automatisch skaliert. Um Ihre Leistungsanforderungen zu erfüllen, passt sich das System automatisch an Ihre Workloads an.

- Optimierte Datenspeicherung. Ihre Daten werden im Search Lake Ihres Projekts gespeichert, der als kosteneffizienter und leistungsstarker Speicher dient. Für Ihre am häufigsten abgefragten Daten steht eine Hochleistungsschicht über dem Search Lake zur Verfügung.

- Zahlen Sie für die Leistung, die Sie benötigen. Bezahlen Sie für Ingest-, Such- und ML-Ressourcen getrennt nach den Workloads, die Sie ausführen.

Worin besteht der Unterschied zwischen Elastic Cloud Serverless und Elastic Cloud Hosted?

Worin besteht der Unterschied zwischen Elastic Cloud Serverless und Elastic Cloud Hosted?

Elastic Cloud ist eine leistungsstarke Plattform für vielfältige Computing-Anwendungsbereiche. Serverlose Projekte sind speziell für Anwendungsfälle entwickelt und bieten eine vollständig verwaltete, automatisch skalierte Erfahrung. Diese Spezialisierung und dieses Betriebsmodell sind das, was Serverless heute auszeichnet.

Wie kann ich herausfinden, ob ich Elasticsearch Serverless oder Elastic Cloud Hosted verwenden sollte?

Wie kann ich herausfinden, ob ich Elasticsearch Serverless oder Elastic Cloud Hosted verwenden sollte?

Elasticsearch Serverless ist derzeit in ausgewählten Cloudanbieterregionen verfügbar, wobei einige Features in Zukunft noch hinzukommen werden. Wir sind voll und ganz darauf fokussiert, unser Serverless-Angebot auf weitere Regionen und Cloudanbieter auszuweiten. Wir empfehlen, die Dokumentation auf technische Kompatibilitätsfragen wie Sicherheit, Compliance und Verfügbarkeit zu überprüfen.

Wie funktioniert der Einstieg in Elasticsearch Serverless?

Wie funktioniert der Einstieg in Elasticsearch Serverless?

Der Einstieg in Elasticsearch Serverless ist ganz einfach:

- Erstellen Sie Elasticsearch Serverless-Projekte in der Cloud Console.

- Wählen Sie den für Ihre Bedürfnisse optimalen, anwendungsfalloptimierten Projekttyp.

- Starten Sie jetzt mit Ihrem anwendungsfalloptimierten Projekterlebnis.

Kann ich Daten zwischen Elasticsearch Serverless und Elastic Stack Hosted migrieren?

Kann ich Daten zwischen Elasticsearch Serverless und Elastic Stack Hosted migrieren?

Wir empfehlen, Daten entweder direkt aus Ihrer Anwendung oder mit Connector-Clients zu senden. Für den Datenversand in einer vorhandenen Elasticsearch-Instanz empfehlen wir die Verwendung von Logstash, um große Datenvolumen zu migrieren.

Was sind die Einstellungen für die Suchleistung?

Was sind die Einstellungen für die Suchleistung?

Suchleistungseinstellungen ermöglichen es Ihnen, die Rechenressourcen zu verwalten, um die Suchleistung (Durchsatz und Latenz) zu optimieren und Kosten zu senken. Es gibt drei Suchleistungseinstellungen für Elasticsearch Serverless-Projekte. Die Einstellung „Performant“ ist standardmäßig aktiviert und bietet ein leistungsstarkes Sucherlebnis für Daten aller Größen. Es ist möglich, eine der folgenden Einstellungen zu wählen:

On-Demand: Automatische Skalierung basierend auf Daten und Suchlast mit einem niedrigeren Mindestwert für den Ressourcenverbrauch. Diese Flexibilität führt zu variabler Abfragelatenz und reduziertem maximalem Durchsatz.

Performant: Liefert durchgehend niedrige Latenz und skaliert automatisch, um einen moderat hohen Abfragedurchsatz zu berücksichtigen

Hohe Verfügbarkeit: Optimiert für Szenarien mit hoher Verfügbarkeit, automatischer Skalierung zur Aufrechterhaltung der Abfragelatenz auch bei sehr hohen Abfrageaufstellungen

Wie viel werde ich zahlen*?

Wie viel werde ich zahlen*?

Bei Elasticsearch Serverless zahlen Sie für die Ressourcen, die zur Bewältigung Ihrer Workloads und zur Erfüllung Ihrer Leistungsanforderungen genutzt werden. Wir haben einige Beispiele zusammengestellt, um Ihnen eine Vorstellung davon zu vermitteln, was Sie bezahlen könnten und wie Sie die Kosten einschätzen sollten.

Beispiel 1 - Entwicklungsumgebung mit 2 GB durchsuchbaren Daten, 1 % Ingest-Auslastung (15 Minuten pro Tag), 8 % Suchauslastung (2 Stunden pro Tag)

- On Demand: 24 $/Monat

- Performant: 27 $/Monat

Beispiel 2 - Produktionsumgebung mit 20 GB durchsuchbaren Daten, 5 % Ingest-Auslastung (1 Stunde pro Tag), 33 % Suchauslastung (8 Stunden pro Tag)

- On Demand: 190 $/Monat

- Performant: 210 $/Monat

Die in den Beispielen angegebenen Preisangaben dienen lediglich der Veranschaulichung. Die tatsächlichen Kosten können je nach Datentyp, Abfragekomplexität, Datenverkehrsmuster, Nutzungsdauer und spezifischen Konfigurationen variieren. Diese Schätzungen sollen Ihnen helfen, mögliche Preisszenarien zu verstehen, sollten aber nicht als endgültige Kosten angesehen werden. Für eine präzise Kostenberechnung empfehlen wir Ihnen, Ihre Nutzung zu überwachen.

Warum werde ich für Search-VCUs abgerechnet, obwohl ich keine Abfragen ausführe?

Warum werde ich für Search-VCUs abgerechnet, obwohl ich keine Abfragen ausführe?

Elasticsearch Serverless hält eine Basis der Suchressourcen für Ihr Projekt bereit, sodass Ihre Daten ohne unnötige Verzögerungen bei der ersten Abfrage nach einer Leerlaufphase durchsuchbar bleiben. Während der aktiven Suche wird Ihnen die gesamten verwendeten Ressourcen berechnet; Während Leerlaufzeiten sinkt die Abrechnung auf einen reduzierten Satz, der an die Größe Ihres suchbereiten Datensatzes und Ihre Suchleistungseinstellung gebunden ist.

Um die Leerlaufkosten zu senken, können Sie die Suchfunktion von Performant (Standard) auf On-Demand umstellen, was die Basislinie senkt und dabei mehr variable Abfragelatenz verursacht. Ingest VCUs hingegen skalieren vollständig auf null, wenn keine Ingest-Aktivität stattfindet.

Wie wird der Elastic Inference Service abgerechnet?

Wie wird der Elastic Inference Service abgerechnet?

Die Nutzung wird ausschließlich anhand des verarbeiteten Datenvolumens abgerechnet, gemessen in Millionen Tokens. Dieses nutzungsbasierte Modell ermöglicht eine lineare Skalierung der Kosten mit Ihrem Durchsatz. So zahlen Sie nur für die tatsächlich verarbeiteten Tokens und nicht für ungenutzte Infrastruktur oder Kapazität.

Wie erfolgt die Abrechnung von Agent Builder?

Wie erfolgt die Abrechnung von Agent Builder?

Die Abrechnung von Agent Builder erfolgt auf Basis der Agent Builder-Ausführungen. Eine Ausführung entspricht jeder abgeschlossenen Interaktion mit einem KI-Agenten (z. B. einem Chat-Eingang und -Ausgang). Komplexere Interaktionen, gemessen an der Anzahl der verwendeten Eingangstoken, werden als zusätzliche Ausführungen abgerechnet (jede Einheit von 50.000 Eingangstoken entspricht einer zusätzlichen Ausführung).

Beispiel 1: Eine Nachricht wird an einen KI-Agenten gesendet, der erfolgreich eine Antwort zurückgibt. In dieser Runde werden 42.000 Eingangstoken verbraucht; dies entspricht 1 Agentenausführung.

Beispiel 2: Eine Nachricht wird an einen KI-Agenten gesendet, der erfolgreich eine Antwort zurückgibt. Die Runde benötigt 325.000 Eingangstoken; dies entspricht 7 Ausführungen.

Beispiel 3: Eine Nachricht wird an einen KI-Agenten gesendet, der auf einen Fehler stößt und keine Antwort zurückgibt. Es werden keine Ausführungen gezählt.

Entdecken Sie alle Möglichkeiten von Elastic Cloud Serverless

Dokumentation

Erfahren Sie, wie Sie serverlose Projekte erstellen, verwalten und ausführen können

Kostenlose Testversion

Starten Sie mit einem einfachen, lösungsorientierten und nutzungsbasierten Preismodell.