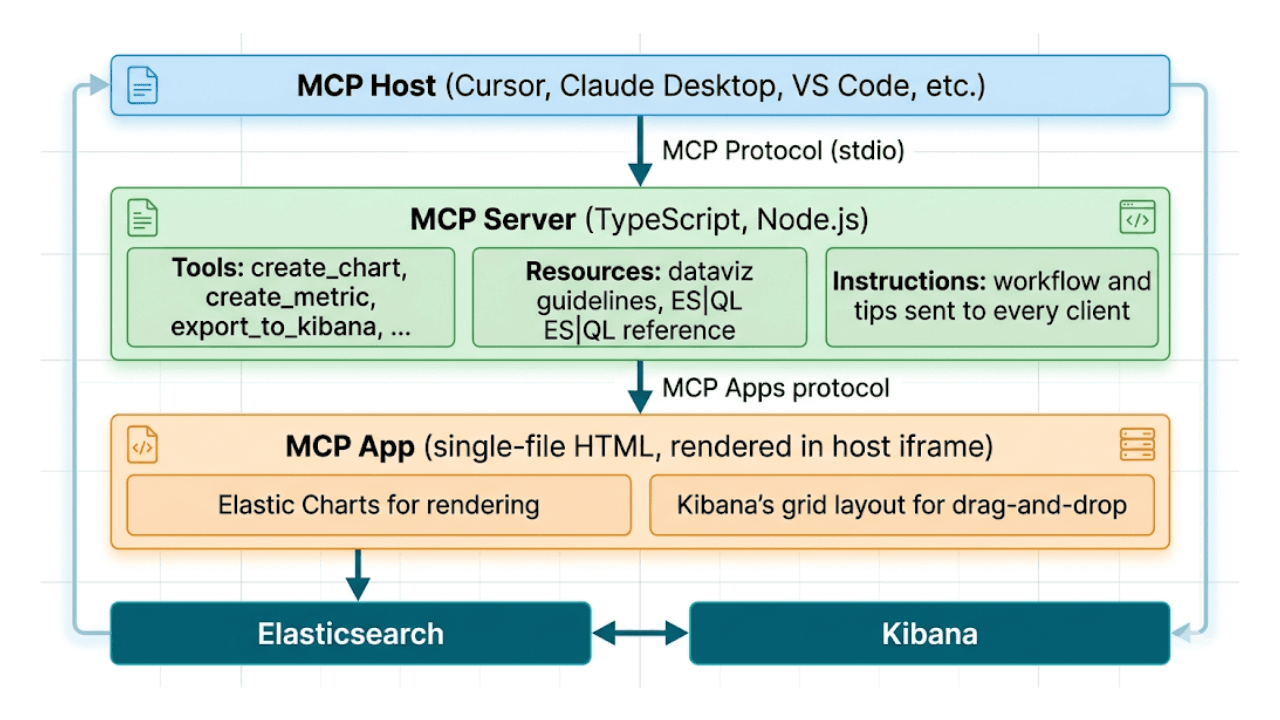

本日、jina-embeddings-v3、Gemini Enterprise Agent Platform Model Gardenでセルフデプロイ可能なパートナーモデルとして利用できる最初のJina検索基盤モデルをリリースします。セルフデプロイとは、モデルがGoogle CloudプロジェクトおよびVirtual Private Cloud(VPC)内のGPUインスタンス上で実行されることを意味します。外部API呼び出しも、トークンごとの課金も、レート制限もありません。

この統合により、Elasticsearchユーザーは、データをセキュリティ境界内に保持し、予測可能なインフラストラクチャコストを実現し、Google Cloud上でネイティブに動作する、新たなデプロイメントオプションを利用できるようになります。同時に、より広範なGoogle Cloudエコシステムで、Jinaが専用に構築した最先端の検索および取得モデルを利用できるようになります。

これは、より広範な展開の第一段階です。次に登場するモデルと合わせると、このラインナップは完全な検索スタックを形成します。データの埋め込み、クエリの埋め込み、候補の検索と再ランク付け、マルチモーダル埋め込みによる画像への検索拡張など、すべてお客様が管理するインフラストラクチャー上で実現します。jina-embeddings-v3の利用は今日から開始できます。このモデルはすでにElastic Inference Service(EIS)を介してElasticsearchエコシステム全体の本番検索パイプラインを支えています。

| モデル | タイプ | パラメーター | 主要な機能 | Model Garden上のステータス |

|---|---|---|---|---|

| `jina-embeddings-v3` | テキスト埋め込み | 572M | 実績のある多言語対応の主力モデル、8,000コンテキスト、1024次元の出力、32次元まで切り捨て可能 | 提供中 |

| 「jina-embeddings-v5-text-small」 | テキスト埋め込み | 677M | 最先端のサブ1B多言語モデル、32,000コンテキスト、1024次元の出力、32次元まで切り捨て可能 | まもなくリリース |

| `jina-embeddings-v5-text-nano` | テキスト埋め込み | 2億3900万 | クラス最高、5億パラメーター、8,000コンテキスト、768次元の出力、32次元まで切り捨て可能 | まもなくリリース |

| `jina-reranker-v3` | リランカー | 600M | リスト別リランキング、131,000コンテキスト、最大64件の文書 | まもなくリリース |

| `jina-clip-v2` | マルチモーダル埋め込み | 900M | 共有スペースのテキスト+画像、89言語、8Kのテキストコンテキスト、512×512の画像 | まもなくリリース |

すべてのモデルは、Google Cloudで最もコスト効率の高いGPUティアである単一のNVIDIA L4(24 GB)で動作します。Google Cloud Model Gardenの他のほとんどの埋め込みモデルではA100 80 GBまたはH100が必要となり、トークンを計算する前から、インスタンスの1時間あたりのコストのおよそ3倍の費用がかかります。

Vertex AIを介してデプロイする場合、追加の商用ライセンスは必要ありません。

Model Gardenを使用する理由とは?

APIを利用するのではなく、Model Garden経由でデプロイする理由はコントロール、コスト、コンテキストの3点にあります。

データが外部に出ることは決してなし

多くの開発者にとっての最大の魅力は、セルフデプロイアーキテクチャーです。Model Gardenを通じてJinaモデルをデプロイすると、Google CloudプロジェクトとVPC内のGPUインスタンス上で加重が実行されます。これは、金融や医療など、データセキュリティに関する懸念を抱える業界で働くすべての人にとって、状況を一変させるものとなるでしょう。外部API呼び出しがないため、機密データはセキュリティ境界内に留まります。

予測によるスケーリング

文章を埋め込んだり、ドキュメントのランキングを変更したりするたびに料金を支払うのではなく、時間単位の固定料金を支払うことになります。また、Jinaのすべてのモデルは、Google Cloudで最も手頃なGPUティアである単一のNVIDIA L4で実行できるため、参入障壁は低いです。1,000件のリクエストを処理する場合でも、10億件を処理する場合でも、インフラストラクチャーの費用は予測可能なままです。これは、トラフィックの増加に対して課金するのではなく、むしろトラフィックの増加に対して報酬を提供する仕組みです。

すべてを一箇所で提供します

データがすでにGoogle Cloud、BigQuery、またはCloud Storage上のElasticsearchに保存されている場合は、推論エンジンをその近くに配置しておくのが理にかなっています。Model Gardenを通じてデプロイすることで、Jinaの検索基盤モデルは、アクセス制御のためのIDとアクセス管理(IAM)、既存のGoogle Cloud請求書での統一された請求、機械学習オペレーション(MLOps)ワークフローのためのVertex AIパイプラインに接続する機能など、すでに使用しているすべてのエンタープライズ機能を継承します。

Jina AI Cloud APIとElastic Cloudはトラフィックの急増や既存の検索ワークフローに対応する最速の手段を提供する一方、Model Gardenは、厳格なデータセキュリティと大規模な運用における予測可能なコストを必要とするエンタープライズアプリケーションに最適です。Elasticは、お客様の現状に合わせてサービスを提供したいと考えています。

Jina AIモデル

jina-embeddings-v3

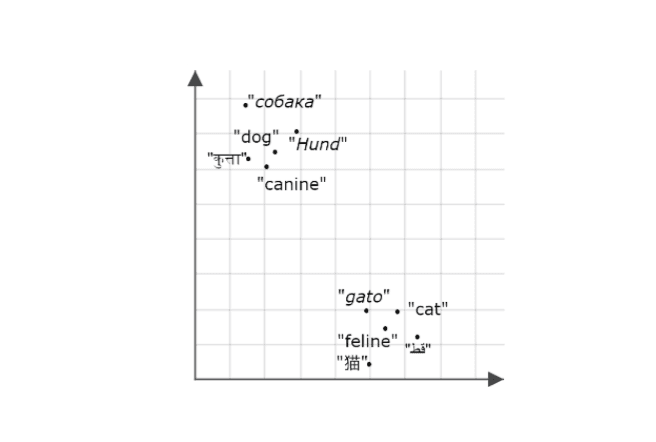

5億7200万個のパラメーターと8000個のトークンコンテキストを備えた、実績のある多言語埋め込みモデル。Massive Text Embedding Benchmark(MTEB)英語で65.5点を獲得しました。5つのタスク固有の低ランク適応(LoRA)アダプター(検索クエリ/パッセージ、テキストマッチング、分類、クラスタリング)と、1024次元から64次元へのマトリョーシカ切り捨てをサポートします。すでにEISを通じてElasticsearchエコシステム全体で広く採用されています。

多くの本番システムが既にv3に依存しているため、当社はいち早くv3を導入しています。v3ベースのパイプラインをGoogle Cloudに移行する場合、埋め込みの次元を変更したり、インデックスを再作成したりすることなく、同じモデルをネイティブに実行できるようになりました。

jina-embeddings-v5-text(smallおよびnano)

2026年2月にリリースされた当社の第5世代テキスト埋め込みモデルは、数倍の規模のモデルに匹敵する最高レベルの性能を実現しています。

v5-text-small (677M)は、9つのタスクタイプの131個のタスクを含むMultilingual MTEB(MMTEB)ベンチマークスイートで67.0点、MTEB英語ベンチマークで71.7点を獲得しています。これは、MTEBリーダーボード上で、10億未満の言語を対象とした多言語埋め込みモデルの中で最も強力なモデルです。

v5-text-nano (239M)はMMTEBで65.5点を獲得しています。5億パラメータ以下の他のモデルでこのレベルに達するものはありません。ほとんどの同等モデルの半分以下のサイズであるため、エッジ環境やレイテンシに敏感な導入環境にとって最適な選択肢となります。

両モデルとも以下をサポートしています。

- 4つのタスク特化型LoRAアダプター:検索、テキストマッチング、分類、クラスタリング。推論時に

taskパラメーターを介して適切なアダプターを選択します。 - マトリョーシカ次元切り捨て:埋め込み次元を1024(nanoの場合は768)から32に削減します。中程度の切り捨て(例えば256次元)では、品質の低下は最小限に抑えられます。次元を半分にすると、ストレージはおよそ半分になります。

- バイナリ量子化:1024次元の埋め込みデータをバイナリ化によって2KBから128バイトに圧縮します。特別な訓練により、この圧縮による損失は最小限に抑えられます。

- 多言語対応:119言語(小型版)と93言語(ナノ版)。

jina-reranker-v3

最後ではあるが遅くない相互作用アーキテクチャーを使用して構築された、0.6Bパラメーターの多言語リスト別再ランカー。クエリと最大64件の候補一致が、131,000トークンの単一のコンテキストウィンドウに入力され、モデルはスコアリングを行う前に文書間の比較を実行します。Jina Reranker v3はBEIRで61.94 nDCG@10を達成し、サイズが6倍小さいモデルを凌駕しています。これは、各文書を個別にスコアリングするポイント別型リランカーとは根本的に異なり、特に単一文書からのパッセージ検索でより良い結果をもたらします。

jina-clip-v2

テキストと画像を共通の1024次元空間にマッピングする、0.9Bのマルチモーダル、多言語埋め込みモデル。以下をサポートします。

- テキスト画像検索に対応する89の言語。

- 512×512の画像解像度。

- 8,000トークンのテキストインプット。

- 両方のモダリティにおいて、マトリョーシカ法による1024から64への次元削減を行います。

画像からテキストへのベンチマーク、特に多言語タスクにおける高い競争力。

はじめに

Jina Embeddings v3が本日、Model Gardenで利用可能になりました。実行する方法を説明します。

Vertex AI APIが有効で、少なくとも1つのg2-standard-8インスタンス(NVIDIA L4)に十分なGPU割り当てがあるGoogle Cloudプロジェクトが必要です。Google Cloudを初めて利用する場合はまずセットアップガイドをご覧ください。

Jina Embeddings v3のModel Gardenページでは、モデルのアップロード、エンドポイントの作成、マシンタイプの選択、デプロイといった一連の流れを詳しく説明しています。自分のプロジェクトでファイルを開き、表示される手順に従ってください。地域や割り当て量によっては、A100およびH100マシンも利用可能ですが、まずはL4で十分です。

クリックから最初の埋め込みまで、すべてのプロセスは数分で完了します。

今後の対応

Jina embeddings v3は出発点です。今後数週間以内に、Jinaの検索スタックの残りの部分、すなわちv5テキスト埋め込み(smallとnano)、jina-reranker-v3、マルチモーダル検索用のjina-clip-v2をModel Gardenに導入する予定です。すべては、同じセルフデプロイモデルで単一のL4 GPU上で実行されます。