今天我们推出 jina-embeddings-v3,这是第一个以可自行部署的合作伙伴模型形式登陆 Gemini Enterprise Agent Platform Model Garden 的 Jina 搜索基础模型。自行部署意味着模型在您的 Google Cloud 项目和虚拟私有云 (VPC) 中的 GPU 实例上运行。没有外部 API 调用,没有按词计量,没有速率限制。

通过此次集成,Elasticsearch 用户获得了一个新的部署选项,能够将数据控制在安全边界内,实现可预测的基础设施成本,并原生运行于 Google Cloud 上。与此同时,更广泛的 Google Cloud 生态系统也能够使用 Jina 专为搜索和检索构建的最先进模型。

这是更广泛发布计划的第一阶段。与后续即将推出的模型一起,这一系列将构成一个完整的检索堆栈:嵌入您的数据、嵌入查询、检索和重排序候选结果、使用多模态嵌入将搜索扩展到图像——所有这些都在您控制的基础架构上完成。您今天就可以从 jina-embeddings-v3 开始,模型已经通过 Elastic Inference Service(EIS)在 Elasticsearch 生态系统中为生产搜索管道提供支持。

| 模型 | 类型 | 参数 | 主要功能 | 在 Model Garden 中的状态 |

|---|---|---|---|---|

| `jina-embeddings-v3` | 文本嵌入 | 572M | 久经考验的多语言主力,8K 上下文,1024 维输出,可截断至 32 维 | 现已提供 |

| `jina-embeddings-v5-text-small` | 文本嵌入 | 677M | 先进的小于 1B 参数多语言模型,32K 上下文,1,024 维输出,可截断至 32 维 | 即将推出 |

| `jina-embeddings-v5-text-nano` | 文本嵌入 | 239M | 5 亿参数以内的最佳模型,8K 上下文,768 维输出,可截断至 32 维 | 即将推出 |

| `jina-reranker-v3` | 重排序器 | 600M | Listwise 重排序器,131K 上下文,最多支持 64 个文档 | 即将推出 |

| `jina-clip-v2` | 多模态嵌入 | 9亿参数 | 文本+图像共享空间,89 种语言,8K 文本上下文,512×512 图像 | 即将推出 |

每个模型都运行在单个 NVIDIA L4(24 GB)上,这是 Google Cloud 上最具成本效益的 GPU 层级。Google Cloud Model Garden 上的大多数其他嵌入模型都需要 A100 80 GB 或 H100,其每小时实例成本大约是 L4 的三倍,这还没有算上词元用量。

通过 Vertex AI 部署时,无需额外的商业许可证。

为什么选择模型花园?

为什么要通过 Model Garden 进行部署,而不是使用 API?归结为三个因素:控制、成本和上下文。

您的数据永远不会离开本地环境

对大多数开发者来说,最大的吸引力在于自行部署的架构。当您通过 Model Garden 部署 Jina 模型时,模型权重运行在您自己的 Google Cloud 项目以及您自己的 VPC 内的 GPU 实例上。这对于任何面临数据安全顾虑(如金融或医疗行业)的从业者来说,都是一个颠覆性的改变。由于没有外部 API 调用,您的敏感数据始终保留在安全边界内。

按预测进行扩展

您不需要为每次嵌入句子或重排序文档付费,而是支付固定的每小时实例成本。而且,因为每个 Jina 模型都可以在 Google Cloud 上最经济的 GPU 级别 NVIDIA L4 上运行,所以入门门槛很低。无论您处理数千个请求还是数十亿个请求,您的基础架构费用都是可预测的。这种模式实际上会奖励您的流量增长,而不是向您征税。

一切尽在同一屋檐下

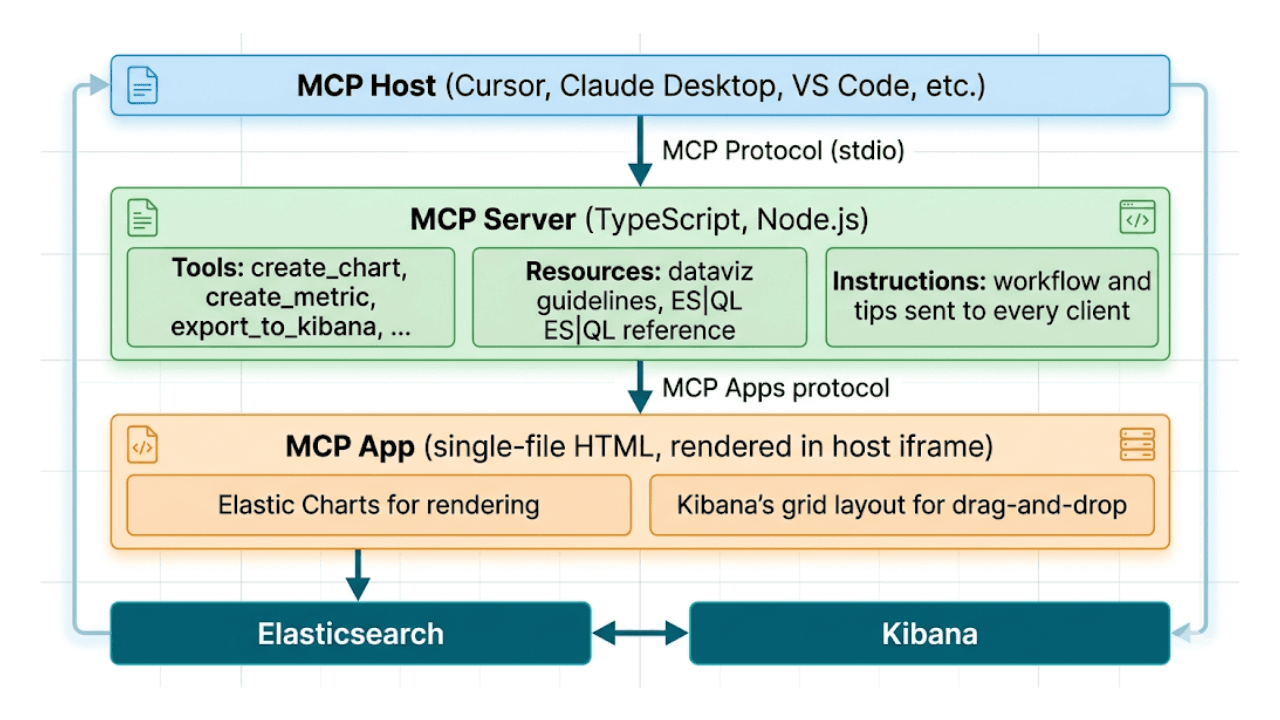

如果您的数据已经存放在 Google Cloud 上的 Elasticsearch、BigQuery 或 Cloud Storage 中,那么将推理引擎保持在这些数据附近是非常合理的。通过 Model Garden 部署,Jina 搜索基础模型继承了您已经在使用的所有企业级功能:用于访问控制的身份与访问管理 (IAM)、在现有 Google Cloud 账单上的统一计费,以及接入 Vertex AI Pipelines 进行机器学习运维 (MLOps) 工作流的能力。

虽然 Jina AI Cloud API 和 Elastic Cloud 为突发流量或现有搜索工作流提供了最快的路径,但 Model Garden 对于需要严格数据安全和大规模可预测成本的企业应用来说是理想选择。Elastic 希望在任何您需要的地方满足您的需求。

Jina AI 模型

jina-embeddings-v3

我们成熟的多语言嵌入模型,具有 572M 个参数和 8K 个词元上下文。在 Massive Text Embending Benchmark (MTEB) 英语测试中获得 65.5 分。支持五种任务特定的低秩适配 (LoRA) 适配器(检索查询/段落、文本匹配、分类、集群)以及从 1024 到 64 维度的 Matryoshka 截断。该模型已通过 EIS 在 Elasticsearch 生态系统中得到广泛采用。

我们首先推出 v3,因为许多生产系统已经依赖于它。如果您正在将基于 v3 的管道迁移到 Google Cloud,您现在可以直接运行相同的模型,无需更改嵌入维度或重建索引。

jina-embeddings-v5-text(small 和 nano)

我们于 2026 年 2 月发布的第五代文本嵌入模型,达到了顶级性能,可与数倍于其规模的模型相媲美。

v5-text-small (6.77 亿参数):在多语言 MTEB(MMTEB)基准套件上得分为 67.0,该套件涵盖 9 种任务类型的 131 项任务;在 MTEB 英文基准上得分为 71.7。它是 MTEB 排行榜上最强大的 10 亿以下多语言嵌入模型。

v5-text-nano (2.39 亿参数):在 MMTEB 上得分为 65.5。没有其他 5 亿参数以下的模型能达到这一水平。其规模不到大多数同类模型的一半,是边缘计算和延迟敏感型部署的自然选择。

两种模型均支持:

- 四个特定任务的 LoRa 适配器:检索、文本匹配、分类、集群。在推理时通过

task参数选择合适的适配器。 - Matryoshka 维度截断:将嵌入维度从 1024(nano 为 768)减少至 32。适度截断(例如 256 维)时质量损失极小。维度减半大致使存储减半。

- 二值量化:使用二值化将 1,024 维嵌入从 2 KB 压缩到 128 字节。专门的训练使得这种压缩的损失极小。

- 多语言:small 支持 119 种语言,nano 支持 93 种语言。

jina-reranker-v3

一个 0.6B 参数的多语言 listwise 重排序器,采用最后但不晚的交互架构。查询和最多 64 个候选匹配项被输入到单个 131K 词元的上下文窗口中,模型在评分前执行跨文档比较。Jina Reranker v3 在 BEIR 上达到了 61.94 的 nDCG@10,优于规模大 6 倍的模型。这与 pointwise 重排序器(对每个文档单独评分)有本质区别,能产生更好的结果,尤其是对于从单个文档中进行段落检索。

jina-clip-v2

一个 0.9B 参数的多模态、多语言嵌入模型,将文本和图像映射到共享的 1024 维空间。它支持:

- 89 种语言的文本图像检索。

- 图像分辨率为 512×512。

- 8K 词元文本输入。

- 针对两种模态的 Matryoshka 截断(从 1024 维到 64 维)

在图像到文本基准测试中表现出色,包括多语言任务。

开始使用

Jina Embeddings v3 即日起在 Model Garden 上线。以下是运行它的方法。

您需要一个启用了 Vertex AI API 的 Google Cloud 项目,以及足够的 GPU 配额用于至少一个 g2-standard-8 实例(NVIDIA L4)。如果您是 Google Cloud 的新用户,请从设置指南开始。

Jina Embeddings v3 的 Model Garden 页面 将引导您完成整个流程:上传模型、创建终端节点、选择机器类型,然后部署。在自己的项目中打开它,并遵循指导步骤。在区域和配额允许的情况下,也可以使用 A100 和 H100 机器,但入门只需 L4 即可。

从点击到首次嵌入,整个过程只需几分钟。

后续计划

Jina Embeddings v3 是一个起点。在接下来的几周里,我们将把 Jina 检索堆栈的其余部分带到 Model Garden:v5 文本嵌入(small 和 nano)、jina-reranker-v3 以及用于多模态搜索的 jina-clip-v2。所有这些模型都将以相同的自行部署模式在单个 L4 GPU 上运行。